近年来,文生图像和文生视频模型取得了重大进展并获得了广泛关注,涌现了dalle 2/3、stable diffusion、stable video diffusion等一批代表性模型。2024年2月15日,openai发布了ai文生视频大模型sora,sora不仅能够一段文字生成长时间高质量流畅视频,更可为通用物理世界模拟提供一种有效的构造方式,为未来的多媒体内容创作与体验开辟了新的可能性。

自2023年以来,哈尔滨工业大学计算学部机器学习研究中心左旺孟团队针对文生图像的个体可控性差、文生3d的多面问题、以及文生视频的单帧质量较低和时域不平滑现象,提出了一系列新模型和新方法,在定制化图像生成、文生3d和文生视频等方面取得显著进展,成果相继发表于iccv、aaai、iclr和cvpr等领域顶级会议。

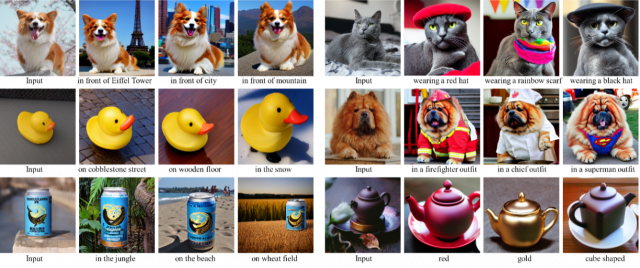

在定制化图像生成方面,团队提出了一种基于模型的快速定制化文本到图像生成方法elite。elite利用全局编码网络将视觉概念直接映射为文本嵌入,并在训练时引入多层特征策略以提升文本嵌入的可编辑性。与此同时,elite采用局部编码网络来补充细节,以更好地平衡定制化生成的一致性和可编辑性。实验表明elite可以在极短的时间内(小于0.1秒)学习新的视觉概念,并可以进行高效的编辑。elite为定制化文本图像生成领域带来了新的方法和思路,不仅提高了生成速度,还保持了生成图像的质量和可控性,对于实际应用中快速生成特定个体的图像具有重要意义。

与现有方法比较

elite生成结果

在文生3d方面,团队分析了多面(janus)问题的产生原因,即2d扩散模型中的视角偏差和优化目标的过拟合。提出了一个两阶段的2d提升框架dreamcontrol,通过将初步的nerf场景作为3d自身先验,利用基于controlnet的分数蒸馏生成精细3d模型。在第一阶段,提出了自适应视角采样和边界完整性度量。在第二阶段,利用条件lora和加权分数进一步优化3d模型的细节纹理,有效避免了文生3d的多面问题。

文生3d结果

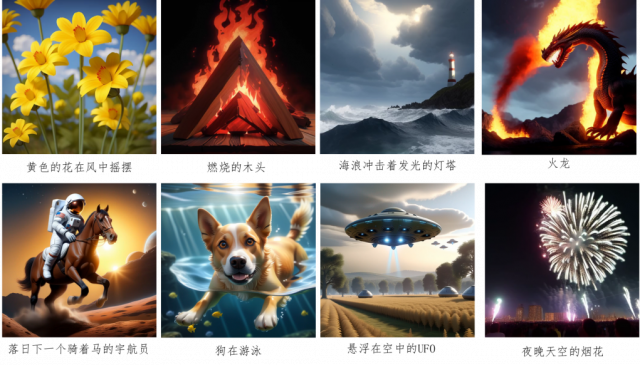

在文生视频方面,团队分别研究了有无引导信息的文生视频任务。针对引导视频生成,团队提出了controlvideo,利用交错帧平滑器、完全互注意力机制和分层采样策略,使得仅用单张nvidia 2080ti gpu生成稳定视频成为可能。针对文生视频,团队提出了一种无需训练的即插即用视频质量提升方法videoelevator,利用文生图像的的优越性能提升文生视频性能。videoelevator主要包括时域运动改善和空域质量提升模块,时域运动改善模块利用封装的文生视频模型来增强时间一致性,空域质量提升模块利文生图像模型增加更多逼真的细节。videoelevator不仅可以通过基础文生图像模型改进文生视频基线模型的性能,还通过个性化文生图像模型实现风格化视频生成。

与sora相比,videoelevator能够达到相当的图像帧质量,但在视频生成的长度和场景复杂性方面仍有显著差距。今后,团队将围绕复杂场景长视频生成及真实性建模继续开展研究,力争在整体上达到接近sora的性能,并在若干单点技术上实现性能赶超。

文生视频结果

除日常生活和娱乐外,在许多航空航天和工业应用中,ai视觉内容生成技术还可用于生成训练数据,缓解数据稀缺和分布不均衡,支持人工智能系统的快速开发与迭代更新。

相关科研成果:

[1] yuxiang wei, yabo zhang, zhilong ji, jinfeng bai, lei zhang, wangmeng zuo,elite: encoding visual concepts into textual embeddings for customized text-to-image generation, iccv 2023.

[2] yufei cai, yuxiang wei, zhilong ji, jinfeng bai, hu han, wangmeng zuo, decoupled textual embeddings for customized image generation, aaai 2024.

[3] tianyu huang, yihan zeng, bowen dong, hang xu, songcen xu, rynson wh lau, wangmeng zuo, textfield3d: towards enhancing open-vocabulary 3d generation with noisy text fields, iclr 2024.

[4] tianyu huang, yihan zeng, zhilu zhang, wan xu, hang xu, songcen xu, rynson wh lau, wangmeng zuo, dreamcontrol: control-based text-to-3d generation with 3d self-prior, cvpr 2024.

[5] yabo zhang, yuxiang wei, dongsheng jiang, xiaopeng zhang, wangmeng zuo, qi tian, controlvideo: training-free controllable text-to-video generation, iclr 2024.

[6] yabo zhang, yuxiang wei, xianhui lin, zheng hui, peiran ren, xuansong xie, xiangyang ji, wangmeng zuo, videoelevator: elevating video generation quality with versatile text-to-image diffusion models, arxiv 2024.